Обзор аппаратных решений для задач искусственного интеллекта: США, Китай, Россия

Блог компании Байкал Электроникс. Автор: Максим Маслов. Технологии искусственного интеллекта активно развиваются и всё больше входят в нашу жизнь. Появление моделей уровня ChatGPT продемонстрировало огромные возможности современного ИИ уже сегодня, вызвав эффект разорвавшейся бомбы. Но применение и развитие технологий искусственного интеллекта невозможно без специализированного аппаратного обеспечения.

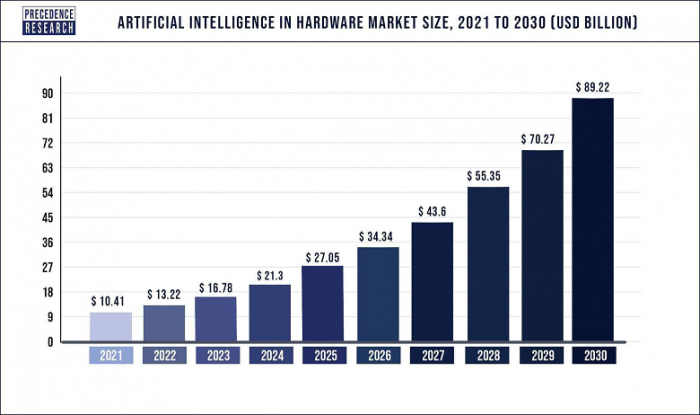

Доступ к такому оборудованию определяет принципиальную возможность участвовать в конкурентной гонке по разработке технологий искусственного интеллекта как на уровне отдельных компаний, так и для государств в целом. Поэтому потребности в железе растут, а в отрасль вливаются огромные деньги. Прогнозы по размерам и перспективам роста рынка AI Hardware есть разные, но в среднем они выглядят примерно так:

В данной статье мы попытаемся сделать краткий обзор состояния индустрии разработки аппаратного обеспечения для искусственного интеллекта, причём мы рассмотрим не только передовые решения сами по себе, но и как они распределены географически по регионам.

Сейчас во всём мире существуют сотни компаний, создающих устройства для искусственного интеллекта. Разобрать их все невозможно, поэтому мы сконцентрируемся на наиболее значимых или интересных разработках (по мнению автора, конечно же). Стоит отметить, что количество различных характеристик, ниш, применений AI Hardware огромно, и во многих случаях нельзя сравнивать решения напрямую. Поэтому в данном материале мы постараемся по возможности абстрагироваться от каких-либо сравнений и оценок, кроме тех случаев, где это будет уместно, и просто дать общее описание текущих флагманских продуктов. Также необходимо иметь в виду, что многие характеристики, декларируемые производителями или собранные по открытым материалам, могут быть «плавающими» и отличаться в разных источниках. Поэтому данный обзор может содержать определённые неточности такого рода, но принципиально картину они не изменят.

Перед тем, как приступить к обзору, уточню несколько моментов:

Все решения для AI можно грубо разделить на 2 класса: предназначенные для обучения нейросетей (training) и предназначенные для работы с уже обученной моделью в реальных применениях (inference). «Железо» может быть специализированным как для решения какого-то одного класса задач (training или inference), так может быть универсальным и применяться в обоих случаях (training и inference).

Обучение нейросетей (training) существенно более ёмко в плане вычислений и требует поддержки форматов данных с более высокой точностью, как правило используются вещественные float32 и float16. Для inference-задач зачастую достаточно меньшего размера данных и как правило применяется целочисленный 8-ми битный формат int8 (и даже бывает int4 или int1).

Также очень важным параметром является размер различных кэшей, расположенных непосредственно на чипе. Это связано с тем, что доступ к ним по сравнению с обращением в память быстрее на порядок. В случае нехватки внутренних кэшей для размещения постоянно используемых данных (например, весов используемых моделей), производительность AI-чипа может падать драматически. В этом случае требуются различные нетривиальные аппаратные и программные трюки, чтобы каким-то образом должны решить эту проблему (что не всегда возможно). Поэтому примерный размер внутренних кэшей под общим наименованием SRAM, по возможности, также будет указываться.

США/Канада/Европа/Израиль

1. Nvidia

Любой обзор такого рода по праву начинается с компании Nvidia.

- Источник(и):

- Войдите на сайт для отправки комментариев

Сайт о нанотехнологиях #1 в России

Сайт о нанотехнологиях #1 в России