Нейросеть превратит слова в движения роботов

Друзья, с момента основания проекта прошло уже 20 лет и мы рады сообщать вам, что сайт, наконец, переехали на новую платформу.

Какое-то время продолжим трудится на общее благо по адресу

На новой платформе мы уделили особое внимание удобству поиска материалов.

Особенно рекомендуем познакомиться с работой рубрикатора.

Спасибо, ждём вас на N-N-N.ru

Исследователи из Сеульского университета создали Text2Action — нейросеть, которая превращает текстовое описание действия в анимацию движений трехмерной модели. Алгоритм работает на основе порождающей состязательной сети и с его помощью можно, например, научить робота понимать текстовое описание действий. Препринт статьи опубликован на сайте arXiv.

Человеческий язык и деятельность тесно связаны: люди способны как выполнять действия, основываясь на их языковом описании, так и описывать действия, наблюдаемые ими. Автоматизация подобной связи — задача сложная; решение ее, однако, важно для современного развития искусственного интеллекта. Авторы новой работы представили нейросеть, которая умеет превращать текстовое описание действия в его выполнение.

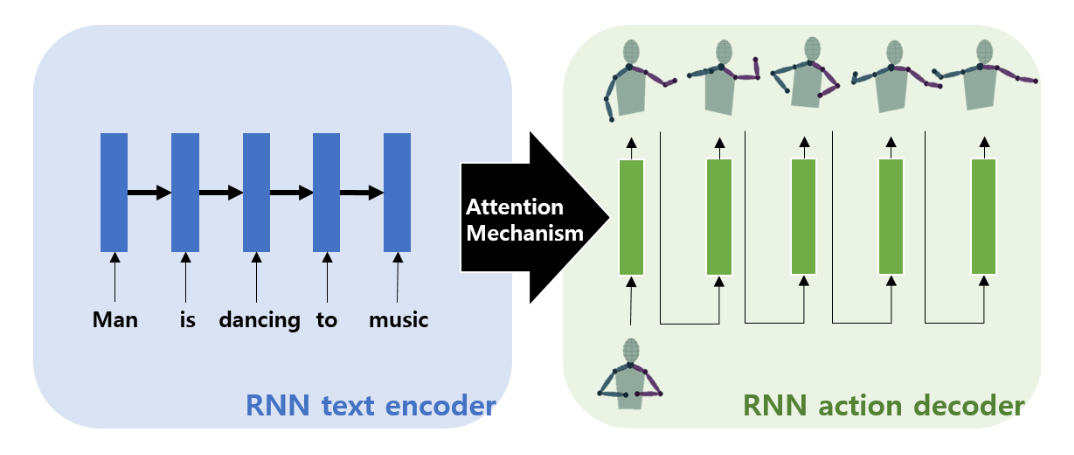

В основе алгоритма лежит порождающая состязательная сеть (англ. generative adversarial network, сокращенно GAN), основанная на модели Seq2Seq (sequence to sequence). Такая нейросеть учится зависимостям между входными и выходными данными, в данном случае — между полученным на вход предложением, обозначающим действие, и соответствующим анимированным изображением. Сама обработка текстовой информации и последующий процесс переработки ее в изображение основан на работе рекуррентных нейросетей.

Модель действий серфингиста на доске в беспокойном океане. Ahn et al. / arXiv 2017

Модель действий серфингиста на доске в беспокойном океане. Ahn et al. / arXiv 2017

Алгоритм работы нейросети. Ahn et al. / arXiv 2017

Алгоритм работы нейросети. Ahn et al. / arXiv 2017

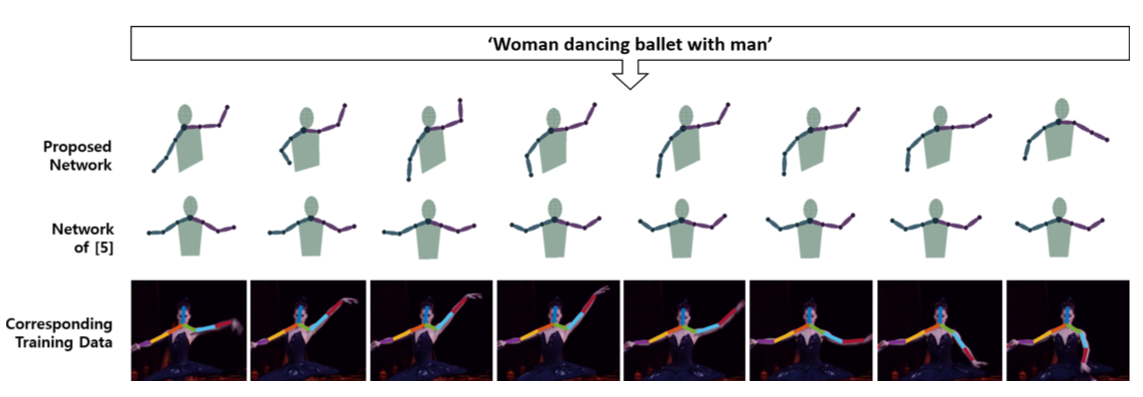

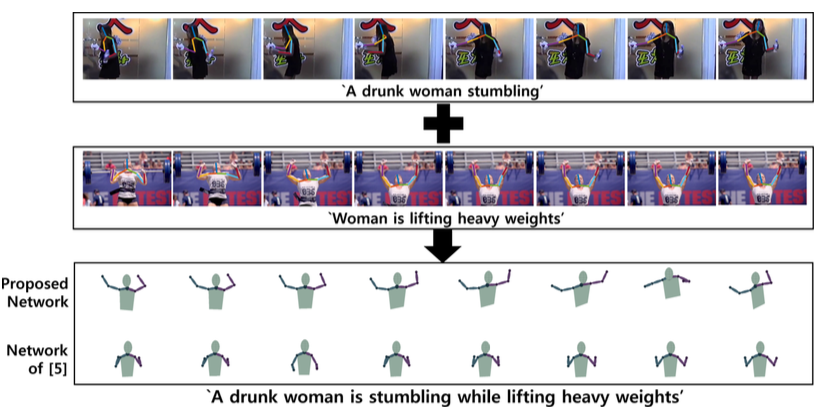

Нейросеть обучили на общедоступной базе данных MSR-VTT, созданной Microsoft — в ней собраны видеоролики различных действий людей и их автоматическое письменное описание. Всего для обучения использовали 29770 пар «описание-видео». В результате нейросеть смогла не только превратить в анимированные модели отдельные предложения, совмещенные с видеорядом, но и создать новые модели на основе сразу нескольких пар «описание-видео». Результаты работы нейросети превосходят в реалистичности алгоритм, представленный ранее.

Результаты работы новой нейросети (первый ряд) и ранее представленного алгоритма (второй ряд) на одной паре «описание-видео». Ahn et al. / arXiv 2017

Результаты работы новой нейросети (первый ряд) и ранее представленного алгоритма (второй ряд) на одной паре «описание-видео». Ahn et al. / arXiv 2017

Результаты работы новой нейросети (первый ряд) и ранее представленного алгоритма (второй ряд) на двух парах «описание-видео». Ahn et al. / arXiv 2017

Результаты работы новой нейросети (первый ряд) и ранее представленного алгоритма (второй ряд) на двух парах «описание-видео». Ahn et al. / arXiv 2017

Кроме того, разработчики интегрировали новую нейросеть в Baxter — робота с открытым исходным кодом, который часто используется исследователями в проектах с машинным обучением (например, для тестирования работы нейроинтерфейса). Исследователям удалось научить робота выполнять действия на основе их текстового описания.

Вариации GAN используются для автоматического порождения изображений на основе различных данных. Так, например, здесь вы можете прочитать о pix2pix, которая превращает простые наброски в фотореалистичные портреты, а здесь — о нейросети, которая рисует оригинальные произведения искусства.

Специально к выходу новости редакция N+1 сделала стикерпак для Telegram: в нем использованы изображения трехмерной модели из статьи.

Автор: Елизавета Ивтушок

- Источник(и):

- Войдите на сайт для отправки комментариев

Сайт о нанотехнологиях #1 в России

Сайт о нанотехнологиях #1 в России